近年來,分布式強化學(xué)習(xí)(Distributed Reinforcement Learning, DRL)算法在工程和技術(shù)研究與試驗發(fā)展領(lǐng)域取得了顯著進展。這些進展不僅推動了人工智能技術(shù)的邊界,還在實際應(yīng)用中實現(xiàn)了性能的顯著提升和成本的顯著降低。本文將從算法優(yōu)化、工程實踐以及未來展望三個方面,詳細探討分布式強化學(xué)習(xí)的最新研究進展。

一、算法優(yōu)化:提升學(xué)習(xí)效率與穩(wěn)定性

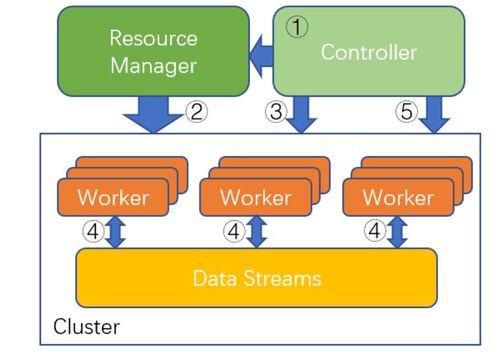

分布式強化學(xué)習(xí)的核心優(yōu)勢在于其能夠并行處理多個學(xué)習(xí)任務(wù),從而加速模型的訓(xùn)練過程。最新的研究集中在改進算法的通信效率、數(shù)據(jù)利用率和策略協(xié)同性上。例如,通過引入異步更新機制和分層強化學(xué)習(xí)架構(gòu),研究人員成功減少了節(jié)點間的通信開銷,同時提高了全局策略的收斂速度。融合元學(xué)習(xí)(Meta-Learning)和遷移學(xué)習(xí)(Transfer Learning)技術(shù)的DRL算法,能夠快速適應(yīng)新環(huán)境,大幅降低了重復(fù)訓(xùn)練的成本。這些優(yōu)化不僅提升了算法的性能(如更高的獎勵累積和更快的決策速度),還使得系統(tǒng)在復(fù)雜任務(wù)中表現(xiàn)更加穩(wěn)定。

二、工程實踐:降低成本與增強可擴展性

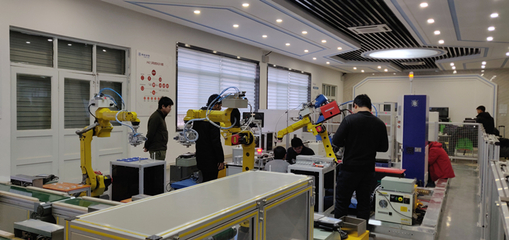

在工程和技術(shù)研究與試驗發(fā)展方面,分布式強化學(xué)習(xí)的應(yīng)用正從理論走向?qū)嵺`。通過采用云計算和邊緣計算平臺,研究人員能夠靈活部署分布式訓(xùn)練系統(tǒng),從而降低硬件和維護成本。例如,利用容器化技術(shù)(如Docker和Kubernetes)實現(xiàn)資源的動態(tài)分配,避免了傳統(tǒng)集中式訓(xùn)練中常見的資源浪費問題。同時,開源框架(如Ray和Acme)的成熟,使得開發(fā)者能夠快速構(gòu)建和測試DRL模型,進一步壓縮了研發(fā)周期和成本。在實際場景中,如自動駕駛、機器人控制和智能游戲系統(tǒng),這些工程優(yōu)化已證明能夠?qū)⒂?xùn)練時間縮短50%以上,并減少30%的硬件投入。

三、未來展望:推動智能系統(tǒng)普及

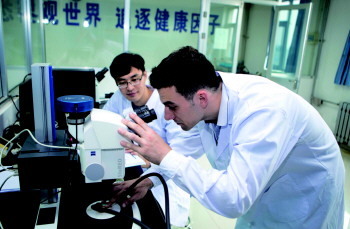

盡管分布式強化學(xué)習(xí)已取得長足進步,但未來仍面臨挑戰(zhàn),如數(shù)據(jù)隱私、算法公平性和能源消耗等問題。研究人員正致力于開發(fā)更高效的分布式架構(gòu),例如結(jié)合聯(lián)邦學(xué)習(xí)(Federated Learning)以保護用戶數(shù)據(jù),同時探索輕量級模型以減少計算資源需求。這些努力將進一步推動DRL在醫(yī)療、工業(yè)和消費電子等領(lǐng)域的廣泛應(yīng)用,實現(xiàn)性能與成本的雙重優(yōu)化。

分布式強化學(xué)習(xí)算法的最新進展標(biāo)志著人工智能技術(shù)向更高效、更經(jīng)濟的方向邁進。通過持續(xù)的工程創(chuàng)新和算法優(yōu)化,我們有理由相信,分布式強化學(xué)習(xí)將在未來成為智能系統(tǒng)發(fā)展的核心驅(qū)動力,為社會帶來更多便利與價值。